Bạn có biết rằng chỉ một dòng lệnh sai trong file robots.txt có thể khiến toàn bộ website của bạn biến mất khỏi Google?

Nghe có vẻ nghiêm trọng, đúng không? Nhưng đó là sự thật.

Rất nhiều quản trị viên website và marketer bỏ qua hoặc hiểu sai cách hoạt động của robots.txt, dẫn đến mất index, giảm thứ hạng, và mất hàng nghìn lượt truy cập mỗi tháng một cách vô hình.

Vậy robots.txt là gì, và làm thế nào để tối ưu file này đúng cách, an toàn và hiệu quả?

Hãy cùng Nghĩa Lê MMO tìm hiểu ngay trong bài viết dưới đây.

Robots.txt là gì?

Robots.txt là một file văn bản đơn giản được đặt ở thư mục gốc của website, có vai trò hướng dẫn trình thu thập dữ liệu (crawler) của các công cụ tìm kiếm như Google, Bing, Yandex… rằng nên thu thập (crawl) và không thu thập những phần nào trên website.

📌 URL mẫu:

https://example.com/robots.txt

🎯 Tại sao robots.txt lại quan trọng trong SEO kỹ thuật?

- Kiểm soát ngân sách crawl (crawl budget) của Googlebot

- Tránh index các trang không cần thiết như /admin/, /cart/, /search…

- Bảo vệ tài nguyên máy chủ khỏi bị crawl quá tải

- Tăng hiệu quả lập chỉ mục cho các trang quan trọng

🔍 Xem thêm: Technical SEO là gì? Hướng dẫn tối ưu toàn diện

Cách Googlebot và các công cụ tìm kiếm sử dụng robots.txt

Khi Googlebot truy cập website của bạn, nó kiểm tra file robots.txt đầu tiên để biết được những gì nó được phép và không được phép làm.

👇 Cách hoạt động:

- Bot truy cập

domain.com/robots.txt - Đọc các dòng lệnh:

User-agent,Disallow,Allow,Sitemap - Quyết định có nên crawl từng URL hay không

🧠 Lưu ý: Nếu không có file robots.txt, bot sẽ mặc định crawl toàn bộ site (trừ khi có lệnh

noindextrong từng trang).

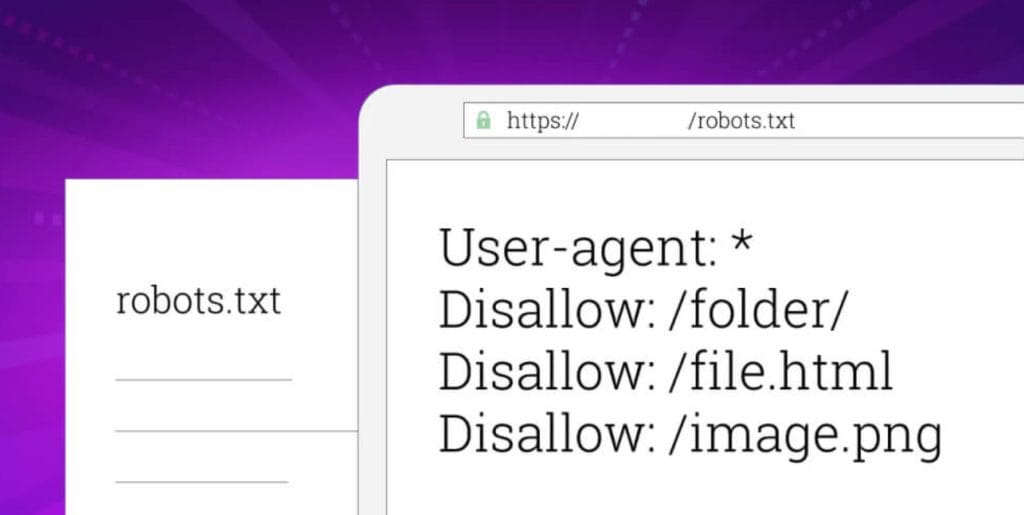

Cấu trúc chuẩn của một file robots.txt

Một file robots.txt nên có cấu trúc rõ ràng và dễ hiểu, sử dụng đúng cú pháp.

🧩 Các thành phần cơ bản gồm:

User-agent: Bot nào được áp dụng (ví dụ: Googlebot)Disallow: Chặn bot truy cập URL cụ thểAllow: Cho phép bot truy cập (dùng trong thư mục bị chặn)Sitemap: Khai báo vị trí sitemap

✅ Ví dụ cơ bản:

User-agent: *

Disallow: /admin/

Allow: /admin/help.html

Sitemap: https://example.com/sitemap.xml

📘 Chi tiết cú pháp được Google công bố tại: robots.txt specifications

Các lệnh phổ biến trong robots.txt và cách sử dụng đúng

Dưới đây là bảng tóm tắt các lệnh thông dụng mà bạn sẽ dùng trong robots.txt:

| Lệnh | Mô tả | Ví dụ |

|---|---|---|

User-agent | Áp dụng cho bot cụ thể | User-agent: Googlebot |

Disallow | Cấm bot truy cập thư mục hoặc URL | Disallow: /checkout/ |

Allow | Cho phép bot crawl trang con trong thư mục bị chặn | Allow: /checkout/help.html |

Sitemap | Gợi ý sitemap để bot crawl nhanh hơn | Sitemap: https://example.com/sitemap.xml |

❗ Không nên dùng robots.txt để chặn các trang bạn muốn “ẩn” khỏi Google – hãy dùng

noindextrong meta robots hoặc xóa URL trong GSC.

Dưới đây là phần cuối của bài viết chuẩn SEO với chủ đề:

“Robots.txt – Hướng dẫn tối ưu hiệu quả cho SEO website”,

được viết bằng Markdown, giọng văn chuyên gia, rõ ràng, tích hợp liên kết nội bộ và ngoài, có hình ảnh đúng vị trí và mô tả chuẩn SEO. Bài viết hướng đến đối tượng khách hàng đang tìm hiểu hoặc triển khai dịch vụ SEO cùng Nghĩa Lê MMO.

Khi nào nên chặn URL trong robots.txt?

Không phải lúc nào cũng nên để Google crawl toàn bộ website. Có nhiều phần trên site không cần thiết xuất hiện trên công cụ tìm kiếm, và việc chặn hợp lý giúp:

- Tiết kiệm crawl budget (ngân sách thu thập dữ liệu của Google)

- Bảo vệ các trang riêng tư hoặc quản trị nội bộ

- Tránh index những URL động, giỏ hàng, bộ lọc… gây loãng chỉ mục

🔒 Các loại URL thường nên chặn:

/wp-admin/,/login/,/checkout/,/cart/,/thank-you//search?query=...,/filter?brand=..., URL có tham số lọc- Trang test, staging, hoặc phiên bản chưa hoàn thiện

Lưu ý quan trọng khi tối ưu robots.txt

Việc tối ưu file robots.txt tưởng đơn giản nhưng nếu cấu hình sai có thể dẫn đến:

- Google không index toàn bộ website

- CSS/JS bị chặn, gây ảnh hưởng đến khả năng render nội dung

- Trang bị ẩn khỏi kết quả tìm kiếm mà bạn không hay biết

📌 Một số lưu ý bắt buộc phải nhớ:

- Không bao giờ dùng

Disallow: /nếu bạn chưa chắc chắn 100% - Đừng chặn thư mục chứa CSS, JS, hình ảnh cần thiết cho hiển thị

- Hãy kiểm tra kỹ trước và sau khi chỉnh sửa file

🔗 Xem hướng dẫn chính thức từ Google: Robots.txt specifications

Công cụ hỗ trợ tạo và kiểm tra robots.txt

Dưới đây là những công cụ đáng tin cậy giúp bạn viết, kiểm tra và tối ưu robots.txt dễ dàng:

- Google Search Console – Robots.txt Tester

- Yoast SEO (WordPress)

- TechnicalSEO.com Robots.txt Generator

- Screaming Frog SEO Spider

🧠 Tại Nghĩa Lê MMO, các dự án SEO kỹ thuật luôn được kiểm tra robots.txt định kỳ nhằm tránh sai sót trong crawl/index.

Những lỗi phổ biến và cách khắc phục

❌ 1. Chặn toàn bộ website:

User-agent: *

Disallow: /

👉 Hậu quả: Google không crawl được bất kỳ nội dung nào.

❌ 2. Không khai báo sitemap:

Thiếu

Sitemap:trong file robots.txt → làm giảm tốc độ index

❌ 3. Sử dụng wildcards sai cú pháp:

Disallow: /page* → Có thể chặn quá mức hoặc sai ý định

✅ Cách khắc phục:

- Luôn kiểm tra với Robots.txt Tester

- Theo dõi lượng trang được index trong Google Search Console

- Thường xuyên kiểm tra log server nếu có kỹ năng kỹ thuật nâng cao

Cập nhật và bảo trì robots.txt định kỳ

Robots.txt không phải file “viết một lần rồi quên”. Mỗi khi bạn:

- Thêm tính năng mới

- Cập nhật cấu trúc URL

- Đưa site ra staging hoặc dev

- Thay đổi chiến lược SEO

👉 Bạn cần kiểm tra lại robots.txt để đảm bảo bot vẫn được phép crawl đúng phần cần thiết và chặn đúng phần cần chặn.

Kết luận

Robots.txt không chỉ là một file text nhỏ, mà là vệ sĩ âm thầm bảo vệ hiệu suất crawl và thứ hạng SEO cho toàn bộ website của bạn.

🎯 Tóm lại, để tối ưu robots.txt hiệu quả, hãy:

- Viết đúng cú pháp, khai báo rõ ràng

- Tránh chặn nhầm nội dung quan trọng

- Kiểm tra file thường xuyên bằng công cụ chính thức

- Tích hợp robots.txt trong kế hoạch Technical SEO tổng thể

🚀 Tối ưu tốt robots.txt = tăng tốc độ index + giảm rủi ro SEO + tăng hiệu quả crawl.

🔗 Đọc thêm các bài viết liên quan tại Nghĩa Lê MMO:

- Technical SEO là gì? Hướng dẫn tối ưu từ A-Z

- Tối ưu sitemap.xml chuẩn Google Search

- Checklist kiểm tra robots.txt và tốc độ index

❓ Câu hỏi thường gặp (FAQ)

1. Robots.txt có ảnh hưởng đến thứ hạng SEO không?

Gián tiếp có. Robots.txt kiểm soát crawl nên nếu sai cấu hình, bot không thu thập nội dung → không index → không xếp hạng.

2. Có cần chặn mọi bot xấu không?

Có thể. Tuy nhiên, nên dùng thêm firewall hoặc cấu hình server vì bots độc hại thường bỏ qua robots.txt.

3. Có thể kiểm tra robots.txt trên website nào đó không?

Hoàn toàn có. Chỉ cần truy cập: https://domain.com/robots.txt

4. Tôi nên cập nhật robots.txt bao lâu một lần?

Sau mỗi thay đổi lớn về cấu trúc website hoặc SEO strategy. Còn lại, nên kiểm tra định kỳ mỗi 1–2 tháng.

Comments